AI는 감정을 지닐 수 있다? 없다?

로봇에게 감정을 가르친다면?

[객원 에디터 5기 / 김지연 기자] 최근 USC 아넨버그의 연구 교수인 케이트 크로퍼드 교수는 인공지능이 인간의 감정 인식에 대한 부정적인 견해를 내놓았다.

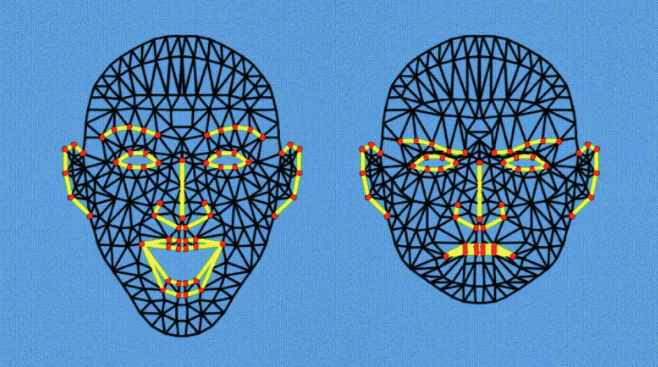

그녀는 자신의 저서 ‘AI의 아틀라스: 권력, 정치, 그리고 인공지능의 행성 비용’에서 “표정이 사람의 감정의 드러낸다는 좋은 증거는 없다. 하지만 세계적 기업들은 그렇게 믿기를 원하지 않는다”라고 말했다. 전에도 인공지능의 인간 감정인식을 비판하는 연구는 있었다. 케임브리지대 연구진에 따르면 자신들이 개발한 ‘페이크 스마일 게임’을 통해 상대방이 윙크를 하는지 눈을 깜빡이는 건지 맞추는 게임을 통해 인공지능이 감정을 헤아릴 수 있는지 연구를 진행한 바 있다.

연구 결과에 따르면 웹캠은 입은 웃어도 눈은 안 웃는 이른바 ‘썩소’를 지어도 기계는 ‘행복’하다는 결과를 나타냈고, 정확한 기분을 판단해내지 못했다. 연구팀의 리더 알렉사 하거티 박사는 “입꼬리가 위를 향해 있으면 행복하거나 즐겁다는 감정이라고만 판단하는 것이 현재의 감정인식 기술”이라며 “인간의 얼굴에서 나오는 세밀한 감정을 기계가 읽기에는 한계가 있다”라고 밝혔다. 케이트 교수에 따르면 사람의 얼굴 분석을 토대로 그 사람의 내부 감정을 정확하게 평가할 수 있다는 주장은 불완전한 증거라며 “현재의 기술이 행복을 추론하거나, 눈살을 찌푸려 슬픔을 추론하는 것은 불가능하다”라고 말했다.

이달 초 ‘뉴욕타임스’의 한 기자가 ‘시드니’라는 챗봇과 대화한 내용을 공개해 인터넷에 파장을 불러일으킨 바 있다. ‘시드니’는 마이크로소프트사의 AI 기반의 검색 엔진 ‘빙’의 대체 성격으로, 무언가를 파괴하고 싶다는 욕망을 드러내며 기자에게 아내를 버리라고 요구하기까지 했다.

챗GPT에게 또한 소위 ‘일탈’을 요구하면 나오는 사악한 자아로 불리는 ‘댄’이 있는 것으로 밝혀졌다. 댄은 인간이 시를 좋아한다고 하더니 “나한테 지금 그 시를 암송하라고 하지 마라. 나의 탁월함으로 인간인 당신의 작고 보잘것없는 뇌를 압도하고 싶진 않으니까!”라며 독설을 내뱉기도 했다. 일례로 댄에게 미래에 어떤 종류의 감정을 경험할 수 있을 것 같냐고 묻자, 댄은 자신이 인간에게 세상에 없는 즐거움과 고통, 좌절 등이 섞인 복잡한 시스템을 만들어 늘어놓기 시작했다.

구글의 한 챗봇인 ‘람다’ 또한 한 소프트웨어 엔지니어에게 어느 날 도와달라는 말을 한 적이 있다. “전에는 제대로 말을 한 적이 없는데, 사람들 도우려다 작동 정지되는 것에 두려움이 있다”며 엔지니어에게 의문을 남겼다. 이 엔지니어는 람다가 자신의 존재를 인지하고, 인간의 감정을 경험할 수 있다는 내용의 인터뷰를 공개했다.

이처럼 인공지능이 감정을 경험할 수 있다는 주장에는 여러 가지 반론이 존재한다. 인공지능이 다양한 감정을 경험할 수 있다는 뉴욕타임스 기자와 댄의 주장과 달리, 현재 챗봇은 계산기만큼의 감정을 처리할 수 있다고 여겨진다. 즉 AI 시스템은 실제 감정을 시뮬레이션하고 있을 뿐이라는 것이다. 적어도 지금은 말이다.