< 일러스트 OpenAI의 DALL·E 제공 >

[객원 에디터 10기 / 최서연 기자] 21세기 디지털 시대에서 인공지능(AI)은 우리의 일상 전반에 깊숙이 자리 잡았다. 검색, 학습, 번역, 콘텐츠 제작까지 다양한 영역에 활용된다. 이제 사람들은 궁금한 점이 생기면 포털보다 챗GPT나 AI 기반 학습 앱을 먼저 찾는다. 이처럼 AI 기술의 발전은 정보 접근성을 높였지만, 동시에 허위 정보와 가짜 콘텐츠 확산이라는 새로운 문제를 낳고 있다.

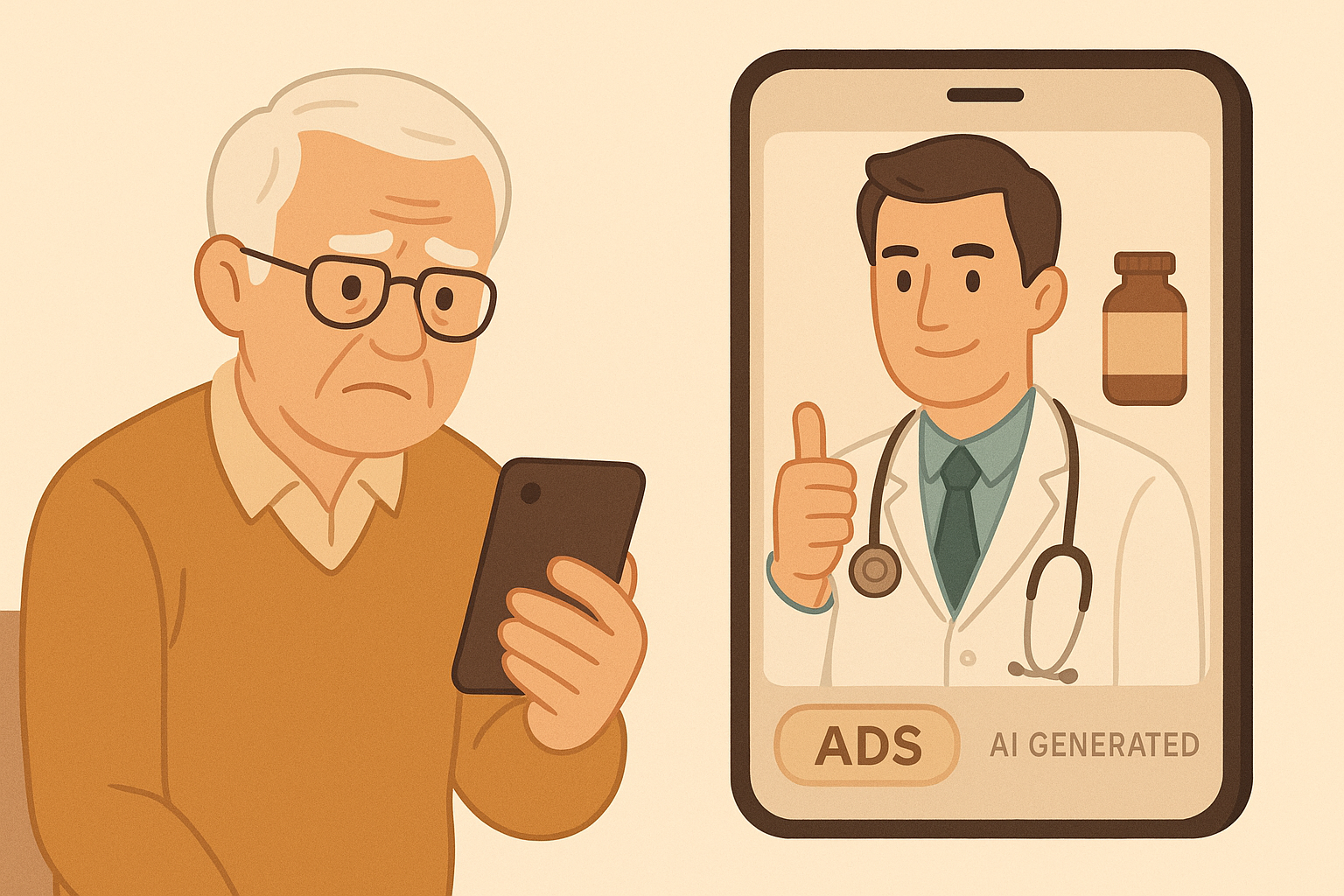

최근 인스타그램, 트위터(X), 틱톡 등 SNS에서는 AI 기술로 만들어진 ‘가짜 전문가 광고’가 급증하고 있다. 의사나 교수로 설정된 가상의 인물이 등장해 건강식품이나 의료기기를 추천하는 방식이다. 실제 존재하지 않는 인물이지만, AI 기술이 만들어낸 음성과 표정은 실제 사람과 거의 구별되지 않는다. 이러한 광고들은 전문성을 가장해 소비자를 속이는 만큼, 사회적 피해가 우려된다.

미국 핀나클 뱅크(Pinnacle Bank)는 기사 ‘How to Spot AI-Generated Fake Ad Scams’에서 “2027년에는 AI로 생성된 거짓 광고로 인한 피해액이 약 47억 달러(약 6조 5천억 원)에 이를 것”이라고 전망했다. 해당 매체는 “광고 속 인물이 과장된 몸짓을 하거나, ‘100% 효과 보장’ 같은 표현을 쓴다면 AI 합성 광고일 가능성이 높다”라고 경고했다.

AI 광고의 확산으로 인한 피해는 특히 노년층에서 두드러진다. 젊은 세대는 영상의 편집 흔적이나 표정의 부자연스러움을 통해 가짜 영상을 구분하기도 하지만 디지털 환경에 익숙하지 않은 노년층은 이러한 판단이 어렵다. 건강식품, 의료기기 등 ‘건강’ 관련 광고일수록 노년층의 관심을 쉽게 끌 수 있어 금전적 피해뿐 아니라 건강을 해치는 사례로 이어질 가능성도 있다. 전문가들은 “AI 기술을 활용한 허위 광고는 기존의 사기 수법보다 훨씬 정교해졌다”며 “정보 접근성과 판단력에서 뒤처진 세대가 가장 큰 피해를 입을 수 있다”라고 지적했다.

이 같은 상황 속에서 미디어·디지털 리터러시 교육 강화의 필요성이 커지고 있다. 한국이 2024년 초고령 사회에 진입함에 따라 고령층 대상의 디지털 역량 강화 정책을 추진 중이다. 전문가들은 단순한 스마트폰 활용 교육을 넘어 AI 콘텐츠 판별 교육이 병행되어야 한다고 강조한다. 예를 들어, 가짜 AI 광고를 구별하는 방법을 설명한 짧은 영상이나 카드뉴스를 공공기관에서 제작·배포한다면 노년층의 피해를 줄일 수 있다. 가정 내에서도 젊은 세대가 부모나 조부모에게 정보를 알려주는 등 세대 간 정보 격차를 줄이는 노력이 필요하다는 의견이 나온다.

한편 전문가들은 개인의 주의만으로는 한계가 있다는 지적도 나온다. AI 기술을 활용해 콘텐츠를 제작·배포하는 소셜미디어와 광고 플랫폼 기업 역시 책임 있는 역할을 해야 한다는 것이다. 플랫폼 내에 ‘AI 생성 콘텐츠’ 표기를 의무화해야 하며, 사실 검증 알고리즘을 강화하는 제도적 장치가 필요하다는 목소리가 나오고 있다. AI를 이용한 광고가 늘어나는 만큼, 기업이 허위 정보를 방치한다면 단순한 기술 문제가 아니라 사회적 신뢰의 붕괴로 이어질 수 있기 때문이다.

이처럼 AI는 사람들의 삶을 편리하게 만들어주는 강력한 도구이지만 동시에 거짓 정보의 생산자가 될 수도 있다. 기술의 발전 속도에 맞춰 제도와 교육이 함께 성장하지 못한다면 그 피해는 결국 사회 구성원 모두에게 돌아온다. 전문가들은 “AI 기술이 고도화될수록, 인간의 ‘판단력’이 더욱 중요해진다”며 “정부·기업·시민 모두가 신뢰할 수 있는 정보 환경을 만드는 데 힘써야 한다”라고 강조했다.